Chapter 4: 하드웨어 — QDD 액추에이터

4.1 왜 하드웨어부터인가

MIT Cheetah가 backflip을 하는 장면은 하드웨어 선언이지 제어 선언이 아니다. backflip을 명령한 정책은 손으로 튜닝된 모델 예측 제어 궤적이었다 — 강화학습의 승리가 아니었다. 데모가 증명한 것은, 적절한 액추에이터를 갖춘 소형 4족 로봇이 모델 기반 제어기가 공중 플립을 실현하고 착지에서 자신을 파괴하지 않을 정도로 충분히 정확하고 빠르고 정직하게 명령된 토크를 실행할 수 있다는 것이다. 하드웨어가 제어의 수표를 현금화했다.

이 장은 Quasi-Direct-Drive (QDD) 액추에이터가 Part II·III의 모든 다른 기폭제 아래의 기저층이라고 주장한다. QDD가 없다면 시뮬레이션에서 학습된 정책은 명령된 관절 토크를 정직하게 실행하지 않는 하드웨어에 착륙한다. 모든 현대 System 0 안에 있는 PD 추종 가정이 실패하고, sim-to-real 간극은 구조적으로 닫히지 않는다. GPU 시뮬, teacher-student RL, sim-to-real 보정은 모두 필수다. 어느 것도 뒤로 움직이기를 거부하는 액추에이터를 보상할 수 없다.

이 장은 다섯 주장으로 진행한다. 첫째(§4.2), QDD를 대안(harmonic-drive 서보, series-elastic actuator)과 대비하여 정의한다. 둘째(§4.3), Seok 외 2013에서 Wensing 외 2017까지의 MIT Cheetah 계보를 추적한다. 설계 원리를 확립하는 표준 참조들이다. 셋째(§4.4), QDD의 장점을 정량화 가능하게 만든 지표로서 Impact Mitigation Factor (IMF)를 설명한다. 넷째(§4.5), 2019–2026년 QDD 템플릿이 Mini Cheetah, Unitree, Berkeley Humanoid, ToddlerBot, Fourier GR-1, Boston Dynamics Electric Atlas로 확산된 과정을 개관하며, 다른 경로를 택한 Cassie/Digit SEA-plus-springs 계보와 비교한다. 다섯째(§4.6), QDD와 RL 기저층을 연결한다. 정책-하드웨어 호환 관계가 정확히 무엇인지, 그리고 QDD가 commoditized되기 전에 왜 legacy 휴머노이드에서 RL이 생산적이지 않았는지. 장은 Part II 판결로 닫힌다(§4.7). QDD는 해결·commoditized이고, 남은 것은 산업 duty cycle에서의 열 여유와 손 수준에서의 촉각 통합이다.

4.2 QDD란 무엇이고 무엇을 대체했는가

2017년 이전 다리형 로봇 설계를 지배한 세 액추에이터 패밀리가 있었다. harmonic-drive 서보, series-elastic actuator (SEA), 직접 구동 전기 모터.

Harmonic-drive 서보 — 고토크 밀도 BLDC 모터 위에 쌓인 고기어비 사이클로이드 또는 harmonic drive — 는 산업 로보틱스의 작업마였다. 100:1에서 200:1의 기어비가 전형적이다. 장점은 출력 측 고토크 밀도, 전류 없이도 유지 토크, 기계적 강성이다. 비용은 낮은 backdrivability(외력이 모터를 움직이기 전에 기어박스의 높은 반사 관성을 극복해야 함)와 낮은 출력 측 토크 센싱 대역폭(load-side 토크 센서나 strain gauge가 필요; 센서 잡음과 센서 대역폭이 힘 제어 루프를 제한)이다. 개방 접촉에서 작동하는 휴머노이드에게 이 비용들은 치명적이다. 모터가 흡수할 수 없는 충격 전이는 기어박스 응력으로 변환되고, 힘 제어 대역폭은 고충실도 전신 제어를 구현하기에 불충분하다.

Series-elastic actuator (SEA) 는 1995년 Gill Pratt과 Matthew Williamson의 힘 제어 문제에 대한 답이었다. 탄성 요소 — 전형적으로 비틀림 스프링 — 가 모터 출력과 부하 사이에 삽입된다. 스프링의 처짐이 양쪽 엔코더로 측정되어 직접적인 토크 읽기가 된다 [2]. SEA는 우수한 수동 compliance (스프링이 충격 흡수), 적당한 힘 제어 대역폭 (전형적으로 20–60 Hz, 스프링의 고유 진동수에 의해 제한), 신뢰할 만한 작동을 제공한다. 정통 SEA 휴머노이드 배포는 Cassie / Digit 계보 [7]이다. Jonathan Hurst의 Oregon State 연구실, 이후 Agility Robotics가 발목의 수동 스프링과 모터 구동 무릎·엉덩이를 결합한 구성 위에 쌓아 올렸다. SEA의 베팅은 힘 제어 대역폭 천장을 수용하고 스프링으로부터 수동 동역학 효율성을 얻는 것이다.

직접 구동 모터 — 기어박스 없이 모터 출력이 부하에 바로 결합 — 는 완벽한 backdrivability와 가능한 최고의 힘 제어 대역폭(모터 전자기에만 제한, 전형적으로 300+ Hz)을 제공한다. 비용은 토크다. 기어 증폭 없이는 가장 토크 밀도 높은 BLDC조차 합리적인 전류 소모로 휴머노이드 무게를 지지할 토크를 낼 수 없다. 직접 구동은 드론 프로펠러와 데스크톱 햅틱 장치에 올바른 선택이다. 다리에는 구조적으로 잘못되었다.

Quasi-direct-drive (QDD) 는 세 극단을 꿰맨다. 커스텀 고갭 반경 외전형 BLDC 모터가 저 기어비 유성기어(전형적으로 5:1에서 10:1; MIT Cheetah의 비율은 단단 유성기어를 통해 5.8:1 [3])와 짝지어진다. 저 기어비는 backdrivability를 직접 구동 수준에 가깝게 유지한다 — 외력은 기어박스를 통해 harmonic-drive의 ~10,000×가 아니라 ~35×의 효과 감소만으로 반사된다. 고갭 반경 모터는 직접 구동이 낼 수 없는 최고 토크를 제공한다. 결과 액추에이터는 backdrivable이고, 100 Hz를 넘는 힘 제어 대역폭을 가지며, load-side 토크 센서가 필요 없고(기어비가 낮을 때 stator 측에서 측정되는 모터 전류가 깨끗한 토크 proxy), 전형적 산업 서보의 약 2.8× 토크 밀도를 달성한다 [3].

QDD를 이해하는 가장 간단한 방법은 직접 구동의 정직성 — 관절 토크 명령이 관절 운동으로 충실하게 실현됨 — 을 보존하면서 다리형 로봇을 지지할 충분한 토크를 다시 사들이는 액추에이터 패밀리로 보는 것이다. 그 정직성이 Part II·III의 모든 하류 기폭제가 의존하는 것이다.

4.3 MIT Cheetah 계보

QDD 설계 원리는 Sangbae Kim의 MIT Biomimetics Robotics Lab으로 거슬러 올라간다. Seok 외의 2013년 ICRA 논문 [1]이 기원이다. 커스텀 외전형 BLDC를 동축 유성기어와 짝지어 문서화하고, 저 임피던스 actuation을 cost-of-transport (COT) 설계 목표로 분석하며, 1세대 MIT Cheetah에서 COT 0.5 — 생물학적 치타에 가깝고 비슷한 규모의 동시대 다리형 로봇보다 약 한 차원 좋음 — 를 보고한다. 2013년 논문이 논제를 확립하고, Wensing 외의 2017년 IEEE Transactions on Robotics 논문 [3]이 그것을 정식화한다.

Wensing 2017은 QDD 설계의 표준 참조다. 세 형식 기여. (1) 갭 반경, 기어비, 토크-대역폭 곱을 관련짓는 proprioceptive 액추에이터 설계 프레임워크, (2) 낮은 기어비에서 모터 전류가 load-side 토크 센서를 대체할 만큼 충실한 토크 추정기라는 증명, (3) 액추에이터가 충돌 전이를 얼마나 잘 흡수하는지의 정규화된 지표로서 Impact Mitigation Factor (IMF) 의 도입. MIT Cheetah에서의 검증은 약 85 ms의 접촉 시간, 450 N 이상의 발 최고 힘, 전형적 산업 서보의 약 2.8× 토크 밀도를 보고한다 [3]. 이 논문의 설계 원리는 이후 12개 이상의 상용·학술 플랫폼에 걸쳐 재현되었다.

Cheetah 1 (2013)에서 Cheetah 3, Cheetah 2, 그리고 궁극적으로 Mini Cheetah (2019)로의 계보는 추적할 가치가 있다. 규모 축소 연습에 매핑되기 때문이다. Cheetah 1은 약 30 kg이었고, 야외 효율성을 목표로 했으며, 1세대 QDD 액추에이터를 썼다. Cheetah 3는 개선된 MPC(Di Carlo 외 2018)로 봉투를 넓혔지만 기본 액추에이터 템플릿은 유지했다. Mini Cheetah [6]는 교육학적으로 결정적인 플랫폼이었다. 9 kg, 약 17 Nm 최고 토크의 12개 모듈러 QDD 액추에이터, 250 Hz 제어 대역폭, 1 kHz 관절 수준 PD 추종으로 30 Hz MPC, 최대 2.5 m/s 속도, 그리고 — 유명하게 — 이 규모급의 첫 공중 backflip. Mini Cheetah가 확립한 모듈러·저비용 템플릿이 Unitree A1, Go1, Go2, 궁극적으로 G1이 거울로 삼은 템플릿이고, 이후 모든 QDD 휴머노이드 플랫폼이 상속한 템플릿이다.

4.4 IMF와 backdrivability의 어휘

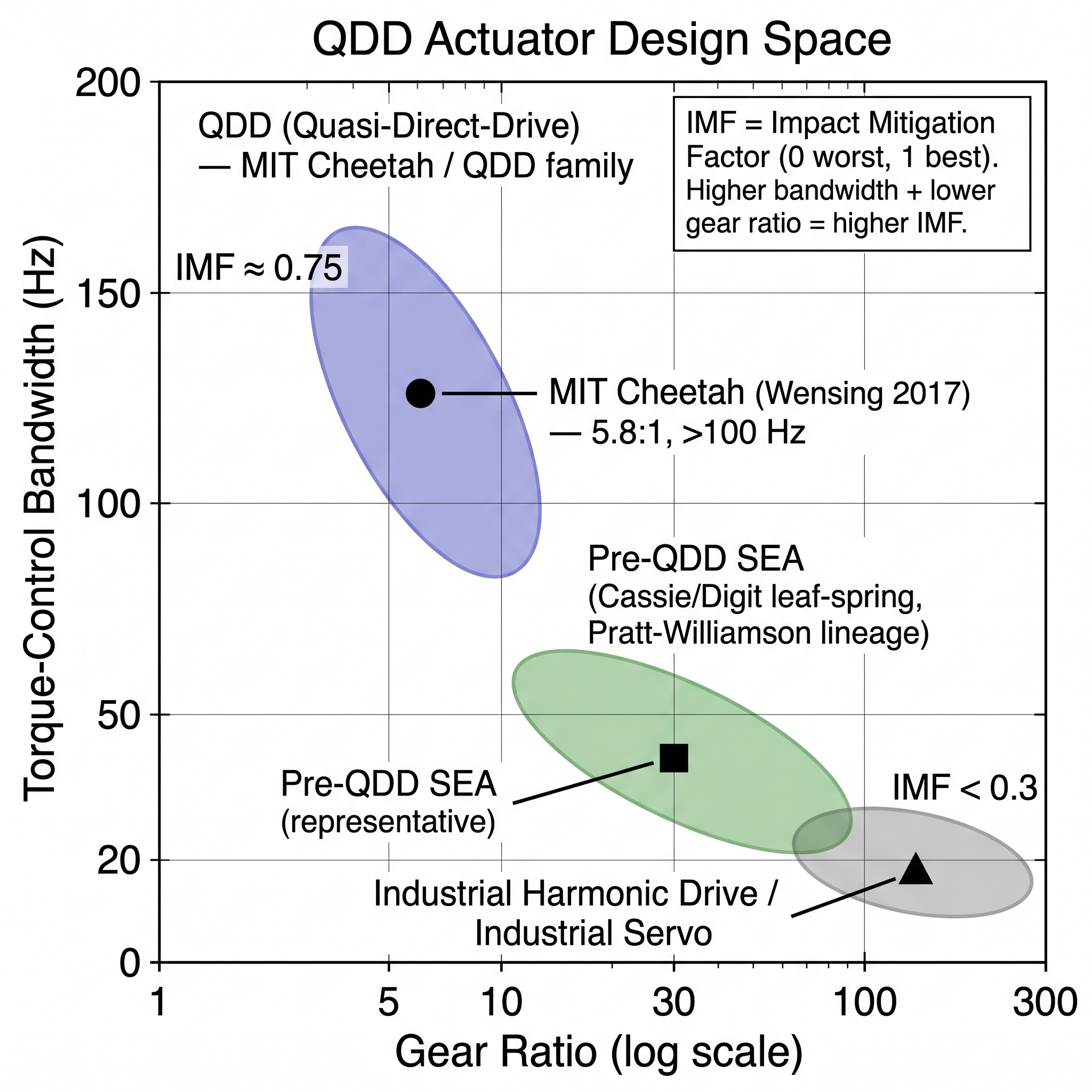

Impact Mitigation Factor (IMF)는 QDD의 설계 이점을 정량화 가능하게 만든 지표다. 대략, IMF는 충격 중 액추에이터가 느끼는 힘 대 환경이 보는 힘의 비율이다 — 높은 IMF는 액추에이터가 충돌을 더 많이 흡수함을 의미하고, 낮은 IMF는 충돌이 기어박스와 모터로 다시 전달됨을 의미한다 [5]. MIT Cheetah의 QDD 설계는 약 0.75의 IMF를 달성한다. 고기어 산업 서보는 전형적으로 0.3 미만이다 [5]. 차이는 화장 수준이 아니다. 0.75의 IMF는 기어박스가 충격력의 약 1/4을 본다는 의미이고, 0.3의 IMF는 기어박스가 적당한 반사 관성 흡수를 뺀 전면적인 타격을 본다는 의미다.

관련 지표로 Cost of Bandwidth per Ampere (CBA) — 소모된 전력 단위당 달성된 힘 제어 대역폭 — 와 Cost of Transport (COT) — 질량당 거리당 기계적 에너지 — 가 있다. QDD의 설계 공간은 둘 다 밀어붙인다. 낮은 기어비는 CBA를 높게 유지하고(힘 제어 대역폭이 높은 반사 관성에 병목되지 않음), 낮은 임피던스와 높은 효율성은 COT를 낮게 유지한다(액추에이터를 극복하는 데 에너지가 덜 낭비됨).

어휘가 중요한 이유는 2019–2026 QDD 확산이 기반으로 하는 교차 플랫폼 비교 기반을 제공하기 때문이다. 새 플랫폼 — Unitree G1, Berkeley Humanoid, ToddlerBot — 이 IMF, 최고 토크, 토크-대역폭 수치를 게시하면, MIT Cheetah의 참조 값과 직접 비교 가능한 수치를 게시하는 것이다. 공유된 어휘가 2019–2026 기간을 경쟁하는 액추에이터 설계의 무차별 싸움이 아니라 수렴으로 만든 것이다.

[3] 5.8:1 기어비, > 100 Hz 대역폭 (IMF ≈ 0.75); pre-QDD SEA (Cassie/Digit 리프 스프링, Pratt–Williamson 계보) 약 30:1, 약 40 Hz; 산업용 harmonic drive 약 160:1, 약 15 Hz (IMF < 0.3). 저자 작성 일러스트 (Gemini 보조 재현), [3]의 설계 프레임워크 논의 및 §4.3–4.4의 수치 명세 기반." loading="lazy" onerror="this.src='../assets/figures/ch04_wensing2017_fig5.png'" style="cursor:zoom-in">

[3] 5.8:1 기어비, > 100 Hz 대역폭 (IMF ≈ 0.75); pre-QDD SEA (Cassie/Digit 리프 스프링, Pratt–Williamson 계보) 약 30:1, 약 40 Hz; 산업용 harmonic drive 약 160:1, 약 15 Hz (IMF < 0.3). 저자 작성 일러스트 (Gemini 보조 재현), [3]의 설계 프레임워크 논의 및 §4.3–4.4의 수치 명세 기반." loading="lazy" onerror="this.src='../assets/figures/ch04_wensing2017_fig5.png'" style="cursor:zoom-in">

4.5 2019–2026 확산

Mini Cheetah 2019 이후 QDD 템플릿은 상용·학술 다리형 로봇 플랫폼 양쪽에 걸쳐 빠르게 확산되었다. 네 사례 연구가 수렴을 예시한다.

Unitree. Unitree Robotics는 4족 시장을 위해 Mini Cheetah 계보를 상용화하고(Go1, Go2), H1 (2023)과 G1 (2024)로 이족 휴머노이드로 확장했다 [9]. G1은 이 시대의 결정적 플랫폼이다. 127 cm 키, 약 35 kg, 23–43 DoF (base 대 EDU 변종), 2 m/s 보행 속도, 90 Nm 무릎 토크(EDU 변종 120 Nm), 2시간 배터리를 갖추고 G1은 US\$16,000에 출하된다 — 다른 벤더의 비슷한 휴머노이드 대비 대략 5–10배 저렴. 이 가격은 Unitree가 4족에서 파생된 QDD 제조를 통제하고, 규모로 운영하며, 마진이 붕괴하는 스택 위를 수직 통합하기를 거부하기 때문에 가능하다. Unitree의 동반 unitree_rl_gym repo [9]는 Train → Play → Sim2Sim → Sim2Real 워크플로를 정식화하여 G1, H1, H1-2, Go2에 대한 RL의 사실상 기본 참조가 되었다. G1 출시 후 12개월 이내에 100편이 넘는 학술 논문이 G1을 하드웨어 플랫폼으로 인용했다 — ASAP sim-to-real 작업(7장)과 6장에서 논의하는 휴머노이드 전신 RL 연구의 상당 부분 포함.

Berkeley Humanoid. Liao 외의 2024년 Berkeley Humanoid [12]는 Unitree G1의 오픈 하드웨어 학술 대응물이다. 0.85 m / 16 kg 플랫폼으로 다리당 6 DoF와 MIT Cheetah 계보의 커스텀 QDD 모듈(hip 62.6 Nm, knee 81.1 Nm)을 갖추고, zero-shot sim-to-real 보행과 수백 미터의 야외 주행을 시연한다. 논문은 정지에서 1초 안에 1 m/s 도달을 보고한다. Berkeley Humanoid는 상용 제품이 아니라 연구 플랫폼이다. 비용은 논문에 문서화되지 않았고, 역할은 Unitree 펌웨어에 의존할 수 없는 연구실에 완전한 하드웨어 통제를 제공하는 것이다.

ToddlerBot. Shi 외의 2025년 ToddlerBot [14]는 저비용 봉투를 더 밀어붙인다. bill of materials가 US\$6,000 미만인 3D 프린팅 가능한 휴머노이드 플랫폼. 논문은 전신 RL 보행과 pick-and-place를 시뮬레이션에서 zero-shot으로, 그리고 두 로봇 협력 장난감 청소 시나리오를 시연한다. ToddlerBot의 아키텍처적 기여는 액추에이터(QDD 모듈은 보수적 commodity 선택)보다 인프라에 있다 — 플러그 앤 플레이 zero-point 보정, 전이 가능한 모터 시스템 식별, 단위별 튜닝 없이 sim-to-real을 허용하는 고충실도 디지털 트윈.

Fourier GR-1. Fourier Intelligence의 GR-1 (2023)과 GR-2 (2024) [13]는 1.65 m 풀사이즈 규모의 중국 학술 연구 플랫폼으로, 40+ DoF와 (GR-2에서) 양손 dexterous 손을 갖는다. GR-1은 NVIDIA의 GR00T N1 학습을 위한 세 참조 embodiment 중 하나로 채택된 것이 주목할 만하다(10장). GR-1, Unitree H1, 1X Neo가 함께 교차 embodiment VLA 작업의 학습 집합을 이룬다.

Electric Atlas. Boston Dynamics의 Electric Atlas [11]는 2024년 4월 16일 유압식 Atlas 은퇴 다음 날 공개되었고, 근본적으로 다른 규모에서의 QDD 스타일 설계의 프런티어급 인스턴스다. Electric Atlas는 56 DoF(인간 한계를 넘는 hyperarticulation — 엉덩이·허리·목에서 360°), 1.5 m 키, 89 kg 질량, 2.3 m 리치, 50 kg 페이로드, 자율 교체가 가능한 4시간 배터리, 85–90% 전기-기계 효율성, 10 cm 미만 발 배치 정밀도를 보고한다. 액추에이터는 커스텀이며 Hyundai Mobis가 Boston Dynamics의 공급업체다. Electric Atlas는 좁은 Mini Cheetah 의미에서 QDD 플랫폼은 아니다 — 액추에이터는 더 산업 등급이고, 고전적 QDD 정의보다 높은 기어비를 갖는다 — 그러나 설계 철학을 상속한다. 학습된 정책을 위한 기저층으로서의 고대역폭 proprioceptive 토크 제어. 11장이 Electric Atlas의 전략적 위치를 자세히 분석한다.

SEA 대안 경로: Cassie / Digit. Agility Robotics의 Digit — Oregon State의 ATRIAS와 Cassie 연구 bipeds의 상용 후손 [7] — 은 다른 액추에이터 아키텍처를 택했다. Cassie와 Digit은 모터 구동 엉덩이·무릎과 발목의 수동 스프링의 조합을 쓴다. 지적 조상은 spring-loaded inverted pendulum (SLIP) 이론이다. 다리 관성을 최소화하고, 질량을 몸통에 집중시키며, 발목의 수동 스프링이 충격 흡수와 에너지 저장의 일을 하게 한다. Cassie/Digit의 베팅은 올바르게 활용된 수동 동역학이 QDD 액추에이터가 능동적으로 충격을 흡수하게 만들려는 것보다 더 저렴하고 효율적이라는 것이다. 그 베팅은 출하되었다 — Digit의 GXO 배포는 2025–2026년 가장 큰 상용 휴머노이드 함대다(12장) — 그러나 한계도 있다. 수동 스프링은 로봇의 동역학 범위를 제약하고(스프링이 낼 수 없는 발목 토크를 임의로 명령할 수 없다), embodiment는 loco-manipulation 통합을 아키텍처적으로 더 제약하는 방식으로 보행에 특화된다.

한국의 변종: AMBIDEX. 덜 다뤄진 대안 경로가 명시적 언급을 받을 만하다. NAVER LABS의 AMBIDEX [4]는 Korea Tech와의 협업으로 개발된 케이블 구동 양팔 매니퓰레이터다. 케이블 구동 아키텍처는 모터를 관절에서 몸통으로 재배치하여 팔 관성을 극적으로 줄이고, 힘 전달에 케이블을 쓴다. AMBIDEX는 compliance 우선 설계 철학이다 — 인간-안전 힘 전달과 낮은 관성이 저기어 backdrivability보다 우선순위를 갖는다. QDD도 SEA도 아니다. 14장이 자세히 다시 다루는 세 번째 아키텍처 경로다. 여기서 그것을 포함한 것은 2019–2026 QDD의 지배가 실증적 결과이지 이론적 필연이 아니며, 대안 액추에이터 철학이 특정 틈새에서 여전히 유효하다는 것을 상기시키기 위함이다.

4.6 왜 QDD가 RL 기저층인가

QDD가 학습된 정책 휴머노이드의 바로 그 기저층이라는 주장은 구체적 명료화를 받을 가치가 있다. 메커니즘은 다음과 같다. 시뮬레이션에서 희망 관절 위치(또는 관절 토크)를 방출하도록 학습된 정책은 특정 암묵 가정을 한다. 실제 하드웨어가 그 명령을 시뮬레이터의 이상화에 가까운 충실도로 추종할 것이라는 가정이다. 모든 현대 System 0 — 고전 PD 제어기든 학습된 10M-파라미터 신경망이든 — 은 희망 관절 상태에서 실현 관절 상태로의 함수이고, "희망"과 "실현" 사이 간극이 sim-to-real이 성과를 내거나 내지 못하는 곳이다.

세 QDD 속성이 이 간극을 닫는다.

Backdrivability 는 환경이 정책이 예측하지 못한 힘을 가할 때 모터가 자신을 파괴하거나 큰 모델되지 않은 토크 스파이크를 생산하는 대신 물리적으로 움직인다는 의미다. 학습된 정책은 구성상 학습 중 유한한 외란 분포만 보았다. 배포는 그 분포 바깥의 외란을 포함할 것이다. Backdrivable 액추에이터는 우아하게 열화된다 — 양보하고, 외력이 소산되도록 하며, 정책의 상태 추정기가 따라잡도록 한다. 고기어 액추에이터는 양보할 수 없고, 명령된 토크와 실현된 토크 사이 불일치는 정책이 실패하거나 하드웨어가 부서질 때까지 자란다.

고 힘 제어 대역폭 은 명령된 토크 변화가 수십 밀리초가 아니라 밀리초 단위로 관절로 전파된다는 의미다. 현대 RL 정책은 100–200 Hz에서 돈다(9장의 System 1)이고 그 속도로 희망 관절 위치를 방출한다. 30 Hz 대역폭의 힘 제어 루프는 그 명령을 충실히 추종할 수 없고, 정책은 자신의 명령과 관절의 응답 사이 지연을 관측할 것이다 — history encoder가 보상하는 법을 학습해야 하거나, 정책의 적응을 오염시킬 지연.

모터 전류를 통한 proprioceptive 힘 센싱 은 힘 제어 루프가 load-side 센서 없이 닫힌다는 의미다. 센서는 질량, 비용, 실패 모드, 지연을 추가한다. 200 Hz 정책은 내부 루프 안에 50 Hz 토크 센서 지연을 원하지 않는다. 모터 드라이버 속도(흔히 >10 kHz)에서 본질적으로 지연 없이 가용한 전류 신호를 원한다.

이 세 속성의 결합이 보행에 대해 sim-to-real 간극(7장)을 닫을 수 있게 만드는 것이다. QDD 액추에이터의 무작위화된 모델에 대해 학습된 정책이 실제 QDD 하드웨어에 배포될 때 보는 잔차 동역학 간극은 몇 퍼센트 수준이다 — 도메인 랜덤화가 그리고 (마지막 몇 퍼센트는) ASAP 스타일의 delta-action 보정이 닫을 수 있는 간극. 같은 정책이 harmonic-drive 서보에 배포되면 수십 퍼센트 수준의 동역학 간극을 보고, 어떤 DR도 꼬리를 덮지 못한다.

Hwangbo 외의 2019년 Science Robotics 결과 [8]는 배포 가능한 규모에서 이 닫힘의 첫 엄밀한 시연이다. QDD의 실제 동역학을 포착하는 액추에이터 네트워크로 학습된 QDD 4족 로봇(ANYmal)이 험지에서 1.6 m/s를 달성. 6장이 이를 전개한다. 4장의 목적상, 요점은 Hwangbo 2019의 성공이 RL 알고리즘 성취일 뿐 아니라 올바른 기저층에서 실행되는 RL 알고리즘 성취라는 것이다. 기저층을 바꾸면 알고리즘은 실패한다.

4.7 판결과 열린 질문

기폭제 1 판결: 해결됨 (commodity). MIT Cheetah 설계 원리 [3] — 외전형 BLDC, 저 기어비 유성기어, 모터 전류 토크 추정, 지표로서의 Impact Mitigation Factor — 는 Unitree G1 (US\$16,000 출시 MSRP), Berkeley Humanoid (오픈 하드웨어 연구 플랫폼), 학술 ToddlerBot (US\$6,000 BOM), Fourier GR-1 / GR-2, 그리고 프런티어급에서 Boston Dynamics Electric Atlas에 걸쳐 재현된다. 하드웨어 primitive는 commoditized되었다. 더 나아간 혁신은 규모 상향(Atlas)과 규모 하향(ToddlerBot) 극단, 그리고 특화된 통합(Figure 03의 3그램 핑거팁 촉각 센서)에서 일어난다. 다리형 보행에 대해 열린 아키텍처 질문은 남지 않았다.

남은 것은 15장과 16장이 다시 다룰 세 특정 프런티어다.

산업 duty cycle에서의 열·전류 보정. 연구 플랫폼은 통제된 환경에서 수 분에서 수 시간 작동한다. 공장 배포는 교대 근무 동안의 지속 duty cycle, 현재 QDD 설계가 실증적으로 검증되지 않은 온도 변동과 모터 권선 열 한계를 요구한다. Figure의 무선 유도 발 충전(12장)은 충전 선언으로 위장된 열 관리 선언이다.

손에서의 촉각 통합. 다리 규모에서 QDD의 성공은 dexterous 손 규모로 아직 전이되지 않았다. Figure 03의 3그램 핑거팁 로드셀과 AgiBot G2의 7-DOF 토크 센싱 팔(13장)이 이 통합의 프런티어다. 어느 것도 commoditized되지 않았고, 2026년 손 액추에이터 설계 공간은 대략 2013–2015년 다리 액추에이터 설계 공간이 있었던 곳이다 — 탐색적, 다경로, 아직 수렴하지 않음. 조작 데이터를 첫 차별화 축으로 다루는 15장 논의가 이 간극으로 돌아간다.

산업 규모의 커스텀 통합. Unitree, Berkeley Humanoid, ToddlerBot은 학술적으로 재현 가능한 QDD를 대표한다. 프런티어 기업 하드웨어 — Figure, Agility, Boston Dynamics — 는 학술적으로 재현 가능하지 않은 커스텀 공급망(Atlas를 위한 Hyundai Mobis, Figure의 BotQ용 in-house)을 수반한다. 14장의 한국 생태계 위치 논의는 이 수직 통합 간극이 정확히 한국 제조 강점이 QDD 제조 이점을 생산할 수 있는 이음새임을 지적한다.

4.8 5장으로의 다리

QDD는 기저층이다. 5장이 다루는 질문은 이렇다. 정직한 기저층이 주어졌을 때, 그것을 활용할 만큼 빠르게 정책을 학습시키려면 어떻게 하는가? 답은 GPU 대규모 병렬 시뮬레이션이고, 2021년의 변곡점 — Isaac Gym [15]과 Rudin 외의 "분 단위로 걷기 학습" [16] — 이 실험당 학습 시간을 수일에서 수 분으로 전환시키고, QDD 하드웨어가 누릴 가치가 있는 도메인 랜덤화 프로그램을 실제로 다룰 수 있게 만들었다.

참고문헌

- Seok, S., Wang, A., & Otten, D. (2013). Design principles for highly efficient quadrupeds and implementation on the MIT Cheetah robot. Proc. IEEE ICRA. doi:10.1109/ICRA.2013.6631038.

- Paine, N., Oh, S., & Sentis, L. (2014). Design and control considerations for high-performance series elastic actuators. IEEE/ASME Transactions on Mechatronics. doi:10.1109/TMECH.2013.2264338.

- Wensing, P. M., Wang, A., Seok, S., Otten, D., Lang, J., & Kim, S. (2017). Proprioceptive actuator design in the MIT Cheetah: Impact mitigation and high-bandwidth physical interaction for dynamic legged robots. IEEE T-RO. doi:10.1109/TRO.2016.2640183.

- Kim, H.-S., Kim, Y.-J., & NAVER LABS. (2017). AMBIDEX: Cable-driven dual-arm manipulator from NAVER LABS. NAVER LABS product / Korea Tech research.

- Kim Lab, MIT Biomimetics Robotics. (2017). Impact Mitigation Factor (IMF) and MIT Cost-of-Bandwidth-per-Ampere (CBA) for legged design.

- Katz, B., Di Carlo, J., & Kim, S. (2019). Mini Cheetah: A platform for pushing the limits of dynamic quadruped control. Proc. IEEE ICRA. doi:10.1109/ICRA.2019.8793865.

- Hurst, J. W. (2019). Cassie bipedal robot and the ATRIAS lineage. Agility Robotics / Oregon State.

- Hwangbo, J., Lee, J., Dosovitskiy, A., Bellicoso, D., Tsounis, V., Koltun, V., & Hutter, M. (2019). Learning agile and dynamic motor skills for legged robots. Science Robotics. (6장에서 자세히 다룸.)

- Unitree Robotics. (2024). Unitree G1 휴머노이드 플랫폼과 `unitree_rl_gym`. Unitree 제품 출시.

- Unitree Robotics. (2023–2024). Unitree H1 휴머노이드 플랫폼 사양.

- Boston Dynamics. (2024). Electric Atlas: 56-DoF 전기 휴머노이드. Boston Dynamics 발표, 2024년 4월.

- Liao, Q., Zhang, B., & Huang, X. (2024). Berkeley Humanoid: A research platform for learning-based control. arXiv preprint 2407.21781.

- Fourier Intelligence. (2024). Fourier GR-1 / GR-2 humanoid platform.

- Shi, H., Wang, W., & Song, S. (2025). ToddlerBot: Open-source ML-compatible humanoid platform for loco-manipulation. arXiv preprint 2502.00893.

- Makoviychuk, V., et al. (2021). Isaac Gym: High performance GPU-based physics simulation for robot learning. NeurIPS Datasets and Benchmarks. arXiv:2108.10470.

- Rudin, N., Hoeller, D., Reist, P., & Hutter, M. (2021). Learning to walk in minutes using massively parallel deep reinforcement learning. Proc. CoRL. arXiv:2109.11978.