Chapter 7: Sim-to-Real 3전략

7.1 Sim-to-real이 실제로 묻는 것

시뮬레이터에 대해 학습된 정책은 시뮬레이터의 동역학을 자신의 가중치에 인코딩한다. 그 정책이 하드웨어에 배포되면, 하드웨어는 또 다른 동역학 시스템이고, 정책의 행동은 두 시스템이 얼마나 가깝게 일치하는지에 의존한다. sim-to-real 간극은 그 두 시스템 사이의 복합 오차이며, 정책이 민감한 모든 차원에 걸쳐 집계된다. 동역학(질량, 마찰, 모터 모델, 접촉), 관측(센서 잡음, 지연, 보정), 보상(정책이 최적화한 보상은 배포 환경이 실제로 지불하는 것이 아니다).

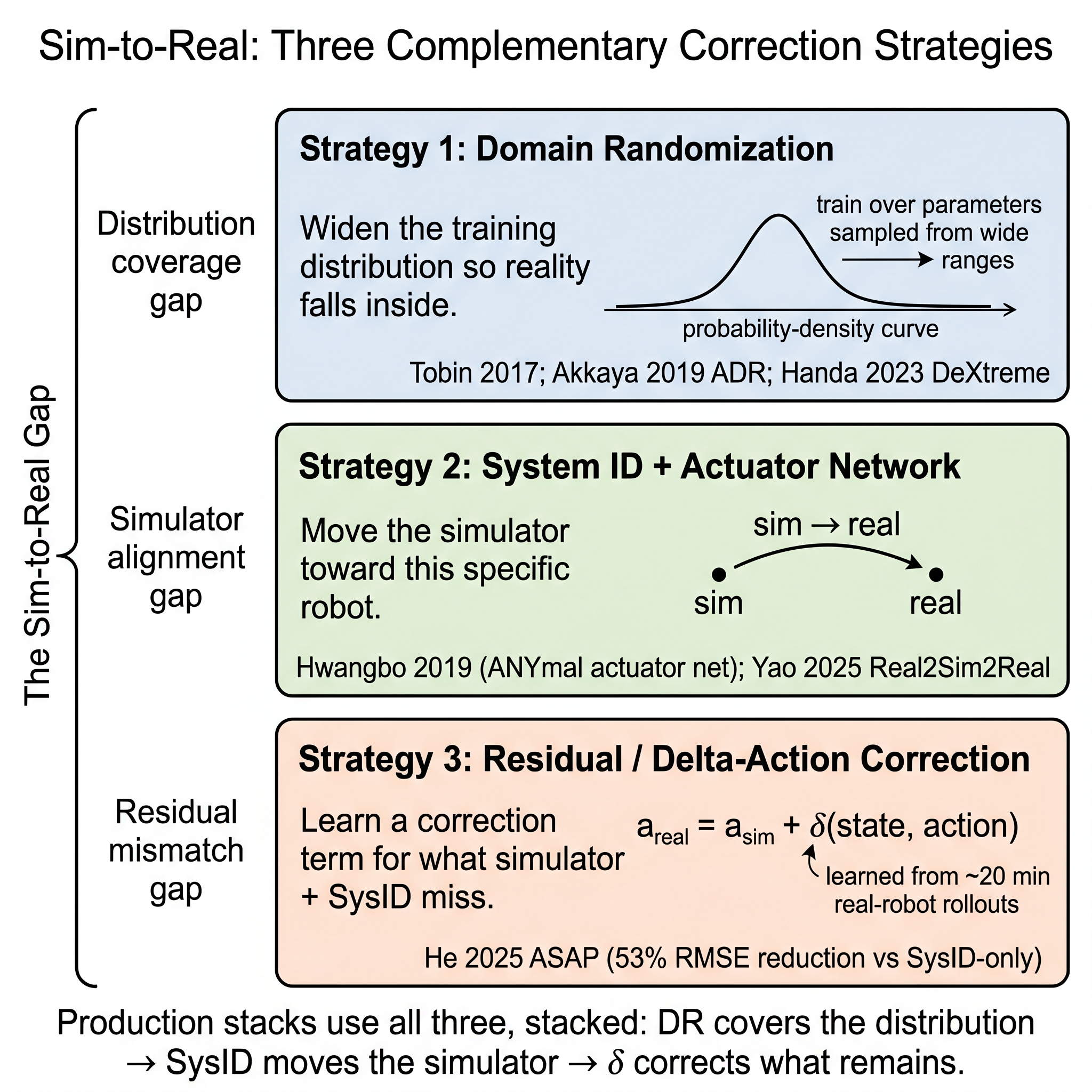

4–6장은 sim-to-real을 가능하게 하는 재료를 기술했다 — 토크를 정직하게 실행하는 QDD 하드웨어(4장), 규모로 분포를 커버할 수 있는 GPU 시뮬레이션(5장), 그리고 student가 proprioceptive 이력으로부터 환경 불확실성에 적응할 수 있게 하는 teacher-student-plus-history-encoder 레시피(6장). 7장은 보정 계층에 대한 것이다 — 상위 장들의 재료가 남긴 잔차 간극을 흡수하는 특정 전략. 세 전략이 2026년 실무를 지배한다.

- 도메인 랜덤화(DR) — 넓은 분포의 시뮬레이션된 환경에 대해 학습하여 실제 로봇이 (높은 확률로) 그 분포 안에 있게 한다. 정확성 대신 커버리지.

- 시스템 식별 + 액추에이터 네트워크 — 실제 로봇의 동역학을 측정한 다음 시뮬레이터를 현실로 이동시킨다.

- 잔차 / delta-action 보정 — 시뮬레이터를 1차 통과로 유지하고, 남은 것을 보정하는 작은 실 데이터 모델을 학습시킨다.

각 전략은 독립적으로 지적으로 방어 가능하다. 실제로는 그들이 쌓인다. 프로덕션 프런티어 휴머노이드 스택이 세 전략을 모두 동시에 사용하며, 다른 전략이 잔차 간극의 다른 영역을 다룬다. 장은 세 전략을 진행한 후(§§7.2–7.4), 세 전략 분류학이 스스로 다루지 않는 관측 공간과 안전 보완(§7.5–7.6)을 다루고, Part II 판결로 닫힌다(§7.7). sim-to-real 보정은 부분 해결이다 — 경계 접촉 보행은 닫혔고, 접촉 풍부 조작이 열린 프런티어로 남는다.

7.2 전략 1 — 도메인 랜덤화

도메인 랜덤화(DR)는 세 전략 중 가장 오래되었고 지배적 기본값이다. 정통 형식화는 Tobin 외의 2017년 IROS 논문 [1]이다. 넓은 분산의 합성 텍스처, 조명, 물체 포즈에 대해 학습하여 실세계 외관이 "학습 중 본 또 다른 변종"이 되게 한다. Tobin의 원 배포는 물체 localization이었다 — 학습에 실 데이터 없이 실물체에 대해 1.5 cm 미만 오차로 zero-shot 전이하는 탐지 [1]. 원리는 비전을 훨씬 넘어 일반화한다.

휴머노이드 보행에 대해 DR은 동역학 관련 양의 10–30개 매개변수 분포에 걸쳐 작동한다. 관절 마찰, 링크 질량, 질량중심 오프셋, 모터 이득, 지형 높이, 지형 마찰, 제어 지연, 관측 잡음 스펙트럼, 외부 외란 크기 등 유사한 것들. 정책은 전체 분포에 걸쳐 성공하도록 학습되며, 이는 암묵적으로 환경 컨텍스트의 robustness 지향 표현을 학습하도록 강제한다. 6장의 teacher-student 레시피가 보완 기계다 — teacher는 지면 진실 매개변수를 보고, student는 proprioceptive 이력으로부터 그들을 추론한다 [6] — 그러나 DR이 student가 추론하는 분포를 만드는 것이다.

두 발전이 DR의 성숙을 진전시켰다. Automatic Domain Randomization (ADR) [4]은 OpenAI의 로봇 손으로 루빅스 큐브 풀기 작업에서 고정 랜덤화 범위를 자율 커리큘럼으로 대체한다. 시스템은 정책의 성공이 열화될 때까지 분포의 범위를 확장한 다음, 정책이 회복될 때까지 확장된 범위를 유지한다. 절차는 수작업 sweep보다 랜덤화 공간의 Bayesian 최적화 스타일 탐색이다. 논문의 시연 — 물리적 실패가 지배하기 전 최대 15회 연속 면 회전으로 루빅스 큐브를 한 손으로 푸는 Shadow Hand [4] — 은 출판된 첫 고위험 sim-to-real dexterous 조작 결과였다.

두 번째 진전은 DR을 통계적으로 의미 있게 만든 GPU 병렬 시뮬레이션 규모다. NVIDIA의 DeXtreme [8]은 단일 GPU에서 3–4k 병렬 환경으로 Isaac Gym에서 Allegro-hand sim-to-real 큐브 재지향을 시연하며 73% zero-shot 성공을 달성한다. GPU 병렬 시뮬레이션 이전 DR의 분포는 연구 약속이었다. 초당 백만 환경 스텝 처리량(5장)에서 DR은 프로덕션 기본값이 되었다. Humanoid-Gym [10], Booster Gym [13], MuJoCo Playground 빠른 보행 파이프라인 [20] 모두가 이 성숙을 상속한다.

DR의 한계는 구조적이다. 시뮬레이터가 샘플할 수 있는 분포를 커버한다. 매개적이지 않은 매개변수(물체 기하, 그립 topology, 접촉 패치 미시 구조, 임의의 재료 점탄성)는 prior 분포에서 샘플 가능하지 않다. DR은 동역학 관련 매개변수가 저차원이고 잘 이해되는 보행에 대해 매우 효과적이다. DR은 중요한 차원이 Gaussian이 아닌 접촉 풍부 조작에 대해 제한적이다. 이 제한이 전략 3이 다루는 것이다.

7.3 전략 2 — 시스템 식별과 액추에이터 네트워크

두 번째 전략은 반대 방향에서 문제를 공격한다. 시뮬레이터의 분포를 넓히는 대신 시뮬레이터를 현실 쪽으로 이동시킨다. 전통적 시스템 식별 — 실제 하드웨어에서 모터 매개변수, 관성 속성, 마찰 계수를 측정하고 1차 원리 시뮬레이터 모델에 꽂음 — 은 노동 집약적이고 일상적으로 불완전하지만 고가치 매개변수에 대한 1차 접근으로 남아 있다.

전략을 진전시킨 2019년 기여는 Hwangbo 외의 액추에이터 네트워크 [3]였다(6장 §6.2). 모터별 강성, 댐핑, backlash, 열적으로 변하는 마찰을 해석적으로 추정하는 대신, Hwangbo와 동료들은 기록된 (관절 상태, 명령된 토크, 실제 토크) 삼중쌍에 대해 작은 MLP를 학습시켰다. MLP 가 시뮬레이터가 쓰는 액추에이터 모델이다. 1차 원리 모델이 포착할 수 없는 비이상성을 모두 흡수한다. 액추에이터 네트워크로 증강된 시뮬레이터에 대해 학습된 정책은 ANYmal에서 1.6 m/s를 달성하며, 25% cost-of-transport 감소와 100개 낙하 포즈 중 80개에서의 회복 [3].

액추에이터 네트워크 접근은 QDD 액추에이터(4장)에 특히 잘 작동한다. 모터 수준 동역학이 1차 원리 모델과 현실 사이 잔차 간극이고, QDD의 backdrivability와 모터 전류 기반 토크 추정이 기록 데이터를 깨끗하고 풍부하게 만들기 때문이다. Booster Gym [13]과 Humanoid-Gym [10]을 포함한 이후 작업이 액추에이터 네트워크 패턴을 상속하고 개선한다.

전략의 2025년 진화가 Real2Sim2Real 자기 지도 시스템 식별 [16]이다. 파이프라인은 짧은 실 로봇 롤아웃을 수집하고, 관측된 state-action-state 전이에 대한 gradient descent로 시뮬 매개변수를 업데이트한 다음, 정렬된 시뮬레이터에 대해 정책을 미세 조정한다. 기여는 새로운 표현적 아이디어가 아니라 자율 루프다. 시뮬레이터가 수작업 매개변수 sweep 없이 스스로 정렬하며, 이는 수작업 sys-ID가 스케일하지 않는 더 높은 차원 매개변수 공간에서 전략 2 접근을 실행 가능하게 만든다. 논문은 수작업 튜닝을 상당히 줄인 채 ASAP(전략 3)에 가까운 성능을 보고한다.

전략 2의 한계는 특정 시점의 특정 로봇을 향해 시뮬레이터를 이동시킨다는 것이다. 로봇이 새 환경에 배포되거나 하드웨어가 노화되면 시뮬레이터-현실 정렬이 표류한다. 전략 2는 일회성 수정이 아니라 진행 중인 유지보수를 요구하는 엔지니어링 실무다. 산업 배포(15장)에 대해 이 유지보수 비용은 사소하지 않다 — 한국 제조의 데이터 수집 강점이 전략적 자산인 이유 중 하나다.

7.4 전략 3 — 잔차와 delta-action 보정

세 번째 전략은 시뮬레이터를 1차 통과로 유지하되, 시뮬레이터와 현실 사이의 잔차를 명시적으로 모델링하고 런타임에 그 잔차 보정을 적용한다. Tairan He와 동료들의 ASAP (Aligning Simulation and Real-World Physics) [14]이 정통 2025년 참조다. ASAP은 두 단계 real-to-sim-to-real 프레임워크다.

- 단계 1: 재타게팅된 인간 mocap에 대해 시뮬레이션에서 모션 추종 정책을 사전 학습.

- 단계 2: 사전 학습된 정책으로 약 20분의 실 로봇 롤아웃을 수집하고, (sim 상태, sim 행동) → 실세계 보정을 매핑하는 delta-action 잔차 모델을 학습시키며, delta-action 모델로 증강된 시뮬레이션에서 정책을 미세 조정.

잔차 모델은 작다 — 전체 물리를 모델할 필요가 없고 시뮬레이터의 예측과 현실의 관측 사이 차이만 필요하다. ASAP은 민첩한 휴머노이드 기술에 대한 상당한 이득을 시연한다. 민첩한 시퀀스에서 시스템 식별 전용 기준선 대비 53%, DR 전용 기준선 대비 38% 관절 추종 RMSE 감소 [14]. 시연은 G1 Kung-fu 킥과 spin을 포함한다 — SysID 단독이나 DR 단독이 생산하지 않은 비교 가능한 품질의 기술.

ASAP이 현금화하는 개념적 주장은 잔차가 모델할 올바른 대상이라는 것이다. 1차 원리 시뮬레이션이 동역학의 쉬운 부분을 다룬다. DR이 "불확실성의 차원" 부분을 커버한다. delta-action 보정이 둘 다 할 수 없는 것 — 특정 로봇의 특정 동역학과 어떤 일반 시뮬레이터 사이의 특이한 불일치 — 을 포착한다. 세 전략은 보완적이다. sim-to-real 간극의 다른 계층을 다루기 때문이다. DR이 분포를, SysID가 시뮬레이터를, delta-action이 잔차를 커버한다.

Yao와 동료들의 Real2Sim2Real 후속 [16]은 ASAP의 delta-action 보정을 자기 지도 sim 정렬 루프의 특수 사례로 재프레이밍한다. 논문은 충분한 실세계 데이터가 주어지면 전략 2(SysID)와 전략 3(delta-action)이 수렴함을 주장한다 — 잘 정렬된 시뮬레이터에 대한 delta-action 모델이 identity가 되고, 잘 정렬된 시뮬레이터가 delta-action 모델을 작게 만든다. 이 수렴이 2026년 연구 프런티어의 공유 가정이다. 실용적 질문은 얼마나 많은 실 데이터가 충분한가이다.

[1]; [4] ADR; [8] DeXtreme); (2) 시스템 ID + 액추에이터 네트워크는 시뮬레이터를 특정 로봇 쪽으로 이동시킨다 ([3]; [16] Real2Sim2Real); (3) 잔차 / Delta-Action 보정은 시뮬레이터 + SysID가 놓치는 것에 대한 보정항을 학습한다 ([14] ASAP, 민첩한 휴머노이드 스킬에서 SysID-only 대비 RMSE 53% 감소). 프로덕션 스택은 세 가지를 모두 쌓아 쓴다. 저자 작성 일러스트 (Gemini 보조 재현)." loading="lazy" style="max-height:160px;width:auto;border-radius:8px;cursor:zoom-in">

[1]; [4] ADR; [8] DeXtreme); (2) 시스템 ID + 액추에이터 네트워크는 시뮬레이터를 특정 로봇 쪽으로 이동시킨다 ([3]; [16] Real2Sim2Real); (3) 잔차 / Delta-Action 보정은 시뮬레이터 + SysID가 놓치는 것에 대한 보정항을 학습한다 ([14] ASAP, 민첩한 휴머노이드 스킬에서 SysID-only 대비 RMSE 53% 감소). 프로덕션 스택은 세 가지를 모두 쌓아 쓴다. 저자 작성 일러스트 (Gemini 보조 재현)." loading="lazy" style="max-height:160px;width:auto;border-radius:8px;cursor:zoom-in">

7.5 관측 공간 sim-to-real

세 전략 분류학은 동역학 sim-to-real을 조직한다. 관측 공간 sim-to-real — 비전, depth, 촉각, IMU — 은 자신의 전략을 갖는 병렬 문제다. 2024년까지 휴머노이드 보행에 대해 대부분의 작업이 proprioception 전용 정책을 썼고, 이는 관측 공간 간극을 완전히 우회한다(6장의 정전은 proprioceptive다). 분야가 비전 조건 보행(Humanoid Parkour [19])과 vision-language-action 모델(10장)로 이동하면서 관측 공간 sim-to-real이 프런티어가 된다.

세 접근이 활발히 사용 중이다. Render 랜덤화 가 DR 스타일 접근이다. 시뮬레이션에서 텍스처, 조명, 재질, 카메라 내부 매개변수를 랜덤화하여 실세계 렌더링이 학습 분포 안에 있게 한다. Tobin 외 2017 [1]이 기초 논문이다. 현대 파이프라인은 학습 규모 처리량에서 물리 기반 렌더링(Isaac Lab의 RTX 통합, MuJoCo Playground의 렌더 파이프라인)을 쓴다.

Depth 전용 정책 이 제한 접근이다. Depth 이미지는 RGB보다 도메인 시프트에 걸쳐 훨씬 안정적이다 — depth 센서는 실내외, 다른 조명, 비, 반사 표면 하에서 대략 같은 거리를 반환한다. Humanoid Parkour [19]는 관측 공간 sim-to-real 간극을 관리 가능하게 유지하기 위해 특별히 teacher-student 증류에 depth 비전을 쓴다. 대가는 정보 손실이다. depth 단독은 색이나 텍스처를 볼 수 없다.

World-model / denoising 접근이 정책과 함께 학습된 동역학 모델을 학습시킨다. Gu 외의 Denoising World Model Learning (DWML) [12]은 학습된 동역학 모델과 denoising 목적을 결합하여 도전적 지형(미끄러운 표면과 계단 유사 지형에서 걷는 RobotEra XBot, 모델 자유 PPO 기준선 대비 +25% 횡단 성공)에서 휴머노이드 보행 robustness를 개선한다. DWML의 프레이밍 — 관측 잡음에 robust한 world model을 학습한 다음 그 안에서 계획하거나 정책을 학습 — 이 관측 공간 측에서 세 전략 분류학을 보완하는 부상하는 2025 연구 방향이다.

7.6 배포 엔지니어링 — 지연, 안전 필터, fallback 제어기

Sim-to-real의 실용적 성공은 분류학이 지명하지 않는 세 번째 축 — 배포 엔지니어링 — 에 의존한다. 실시간 제약을 충족할 수 없고, 안전 계층과 중재할 수 없고, 추론이 실패할 때 되돌아갈 수 없는 sim-to-real 가능 정책은 배포 불가능하다. 세 패턴이 2026년 실무를 정의한다.

지연 예산. System 0/1/2 아키텍처(9장)는 특정 주파수 계층에 커밋한다. 1 kHz System 0, 100–200 Hz System 1, 7–10 Hz System 2. 각 계층의 추론은 관측 전처리, 네트워크 forward pass, 후처리, 명령 디스패치를 포함한 예산에 맞아야 한다. Transformer history encoder(6장)는 추론 비용이 컨텍스트 길이와 함께 스케일하기 때문에 System 1 예산에 부담을 준다. 더 긴 attention이 robustness를 개선한다는 Radosavovic 2024의 발견 [11]은 이 벽에 부딪힌다. 감당 가능한 가장 긴 컨텍스트를 엔지니어링하는 것이 프런티어 스택의 명시적 최적화다.

안전 필터. QP 기반 안전 필터 패턴(2장 §2.3, 4장)이 학습된 정책 아래에서 작동한다. Agility Robotics의 Motor Cortex — "always-on safety layer"로 기술됨 [18] — 이 상용 인스턴스다. He 외의 Agile But Safe (ABS) [9]이 해당 연구 패턴을 제공한다. 빠른 "agile" 정책이 고속 달리기를 다루고(Unitree Go1에서 3.1 m/s, 100 회 중 0 충돌), 보수적 회복 정책이 안전 위험 하에서 인수하며, 학습된 reach-avoid 값 함수가 그들 사이 gate를 건다. ABS의 특정 결과(3.1 m/s, 0 충돌)가 이중 정책 패턴을 검증한다. 일반 패턴 — 역량을 위한 한 정책, 안전을 위한 한 정책, 학습된 중재자 — 이 프런티어 프로덕션 스택에 걸쳐 재등장한다.

Fallback 제어기. 학습된 추론이 실패하거나 out-of-distribution 관측을 탐지할 때 고전 제어기가 명령을 맡는다. 보행에 대해 fallback은 전형적으로 보수적 균형 목표를 갖는 전신 QP다(2장). 전신 동작에 대해 fallback은 전형적으로 더 느리지만 정적으로 안정적인 궤적이다. 패턴은 Boston Dynamics의 하이브리드 MPC+RL 아키텍처(11장)에 명시적이다. MPC가 2024년 이후 Atlas 작업의 주요 제어기는 아니지만, RL이 중재하는 대상으로 항상 가용한 fallback이다. fallback의 존재가 산업 배포가 학습된 정책을 허용하는 이유다 — 학습된 정책이 증명 가능한 보장을 갖는 제어기로 우아하게 실패할 수 있으면 안전 사례가 다루기 쉽다.

7.7 판결과 열린 질문

기폭제 4 판결: 부분 해결됨. 세 전략이 공존하고 쌓인다. 보행에 대해 문제는 닫혔다. GPU 병렬 규모에서의 도메인 랜덤화가 시뮬 가능 분포에 걸쳐 robust한 정책을 생산하고, 액추에이터 네트워크를 갖는 시스템 식별이 각 embodiment에 대해 시뮬레이터를 정렬하며, delta-action 잔차 보정(ASAP)이 마지막 몇 퍼센트를 다룬다. Seo 외의 15분 sim-to-real 보행 결과 [15]가 닫힘을 예시한다 — 보행에 대해 sim-to-real은 이제 15분 엔지니어링 과제이지 연구 문제가 아니다.

접촉 풍부 조작에 대해 문제는 미해결이다.

- delta-action 등가물이 양손 물체 조작에 대해 시연되지 않았다. ASAP의 잔차 보정은 보행의 접촉이 주로 발-지면이며 시뮬레이터 접촉 모델 + DR에 의해 잘 커버되기 때문에 작동한다. 조작의 접촉은 재료 의존 마찰을 갖는 작은 접촉 패치에서의 핑거팁-대-물체이며, 잔차 구조가 질적으로 다르다.

- OmniRetarget 스타일의 상호작용 메시 접근 [17]은 물체 메시가 가용할 때 작동한다. 공장 조작에서 메시 가용성은 제조 특화 자산이다(한국의 자동차와 반도체 부문은 대부분의 부품에 대해 CAD를 가진다). 가정 조작에서는 그렇지 않다.

- 교차 embodiment sim-to-real — Unitree G1을 위해 학습된 정책이 Figure 03에 배포됨 — 은 열린 문제로 남는다. end-effector 6D 자기 보정을 위한 Figure의 "visual proprioception model"(12장)이 가장 가까운 공개 시도다. 어떤 일반화된 교차 embodiment sim-to-real 패턴도 commoditized되지 않았다.

위 세 열린 프런티어 각각은 15장이 전개하는 차별화 축 중 하나 이상에 매핑된다. 한국 제조가 조작 sim-to-real 문제에 대해 이례적으로 잘 위치해 있다는 15장의 주장은 특정 일치에 근거한다. 한국은 메시 자산(CAD 아카이브), 배포 환경(경계된 분산의 공장), capex 정당화(감소하는 노동 공급)를 갖고 있으며, 이는 공장 우선 조작 sim-to-real 프로그램이 가정 우선 프로그램이 할 수 없는 방식으로 복리화할 수 있게 한다.

7.8 Part III으로의 다리

Part I과 II가 이제 완성되었다. Part I은 정통파 스택(1장), 학습 시대로의 생존자들(2장), 패러다임 전환 지도(3장)를 감사했다. Part II는 네 기폭제를 추적했다. QDD 하드웨어(4장), GPU 병렬 시뮬레이션(5장), teacher-student 학습 정전(6장), sim-to-real 보정(7장). 각 기폭제가 판결로 닫힌다. 집계 판결은 3장 §3.4 표이며, 15장이 차별화 축 주장에 봉사하여 재개방한다.

Part III은 기폭제가 가능하게 하는 스택을 다룬다. 8장이 현대 이론 입문 — RL, Transformer, diffusion policy, VLA 개념 — 을 제공한다. 9장의 아키텍처 합성과 10장의 VLA 장 전에 독자가 필요로 하는 것. 고전 제어 배경이 2장에서 다뤄진 독자는 8장을 짝 동반자로 사용할 것이다. 현대 RL 배경으로 도달한 독자는 2장을 자신의 것으로 쓸 것이다.

참고문헌

- Tobin, J., Fong, R., Ray, A., Schneider, J., Zaremba, W., & Abbeel, P. (2017). Domain randomization for transferring deep neural networks from simulation to the real world. Proc. IROS. arXiv:1703.06907.

- OpenAI et al. (2019). Learning dexterous in-hand manipulation. IJRR. arXiv:1808.00177.

- Hwangbo, J., Lee, J., Dosovitskiy, A., Bellicoso, D., Tsounis, V., Koltun, V., & Hutter, M. (2019). Learning agile and dynamic motor skills for legged robots. Science Robotics. arXiv:1901.08652.

- Akkaya, I., Andrychowicz, M., et al. (2019). Solving Rubik's cube with a robot hand. arXiv preprint 1910.07113.

- Lee, J., Hwangbo, J., Wellhausen, L., Koltun, V., & Hutter, M. (2020). Learning quadrupedal locomotion over challenging terrain. Science Robotics. arXiv:2010.11251.

- Kumar, A., Fu, Z., Pathak, D., & Malik, J. (2021). RMA: Rapid motor adaptation for legged robots. Proc. RSS. arXiv:2107.04034.

- Dao, J., Duan, H., Apgar, T., & Hurst, J. (2022). Sim-to-real learning of all common bipedal gaits via periodic reward composition. Proc. IEEE ICRA. arXiv:2011.01387.

- Handa, A., et al. (2023). DeXtreme: Transfer of agile in-hand manipulation from simulation to reality. Proc. IEEE ICRA. arXiv:2210.13702.

- He, T., et al. (2024). Agile but safe (ABS): Learning collision-free high-speed legged locomotion. Proc. RSS. arXiv:2401.17583.

- Gu, X., Zhang, Y., Wu, K., et al. (2024). Humanoid-Gym: Reinforcement learning for humanoid robot with zero-shot sim2real transfer. arXiv preprint 2404.05695.

- Radosavovic, I., et al. (2024). Real-world humanoid locomotion with reinforcement learning. Science Robotics. arXiv:2303.03381.

- Gu, X., et al. (2025). Advancing humanoid locomotion: Mastering challenging terrains with denoising world model learning. arXiv preprint 2408.14472.

- Wang, Y., et al. (2025). Booster Gym: An end-to-end reinforcement learning framework for humanoid robot locomotion. arXiv preprint 2506.15132.

- He, T., et al. (2025). ASAP: Aligning simulation and real-world physics for learning agile humanoid whole-body skills. Proc. RSS. arXiv:2502.01143.

- Seo, S., et al. (2025). Learning sim-to-real humanoid locomotion in 15 minutes. arXiv preprint 2512.01996.

- Yao, X., et al. (2025). Real2Sim2Real: Self-supervised system identification for zero-shot humanoid deployment. arXiv preprint 2506.12769.

- Yang, H., et al. (2025). OmniRetarget: Interaction-preserving data generation for humanoid whole-body loco-manipulation and scene interaction. arXiv preprint 2509.26633.

- Agility Robotics. (2025). Motor Cortex: An always-on safety layer for Digit. https://agilityrobotics.com

- Zhuang, Z., et al. (2024). Humanoid parkour learning. Proc. CoRL. arXiv:2406.10759.

- Zakka, K., et al. (2025). MuJoCo Playground: An open-source framework for GPU-accelerated robot learning and sim-to-real transfer. arXiv preprint 2502.08844.