Chapter 10: VLA와 Loco-Manipulation 통합

10.1 VLA가 휴머노이드 스택에 요구하는 것

Vision-Language-Action(VLA) 모델은 이미지 관측과 자연어 지시를 받아 로봇 행동 시퀀스를 방출한다. 한 문장으로는 야심이 크지 않다. 시스템으로는 2023–2026년 프런티어의 하중을 지탱하는 아키텍처 베팅이다. 보행(6장)과 3-레이어 아키텍처(9장)는 전제 조건이고, 비전·언어·loco-manipulation을 흡수하는 단일 정책은 post-catalyst 스택을 경제적으로 흥미롭게 만드는 통합 논제다.

8장 §8.7이 최소 VLA 어휘를 제공했다. 이 장은 범주를 전개한다. 어떤 VLA 시스템이 존재하는지, 어떻게 아키텍처되는지, 교차 embodiment 일반화가 실제로 어떻게 보이는지, 지배적 기업 스택 각각이 VLA 설계 공간을 어떻게 차지하는지, 그리고 무엇이 열려 있는지. 이 장은 의도적으로 책의 세 번째로 밀도 높은 장이다(6장과 12장 다음). 2024–2026년 VLA 문헌이 폭발했고, 서베이의 책임은 구조적 비교를 잃지 않고 압축하는 것이다.

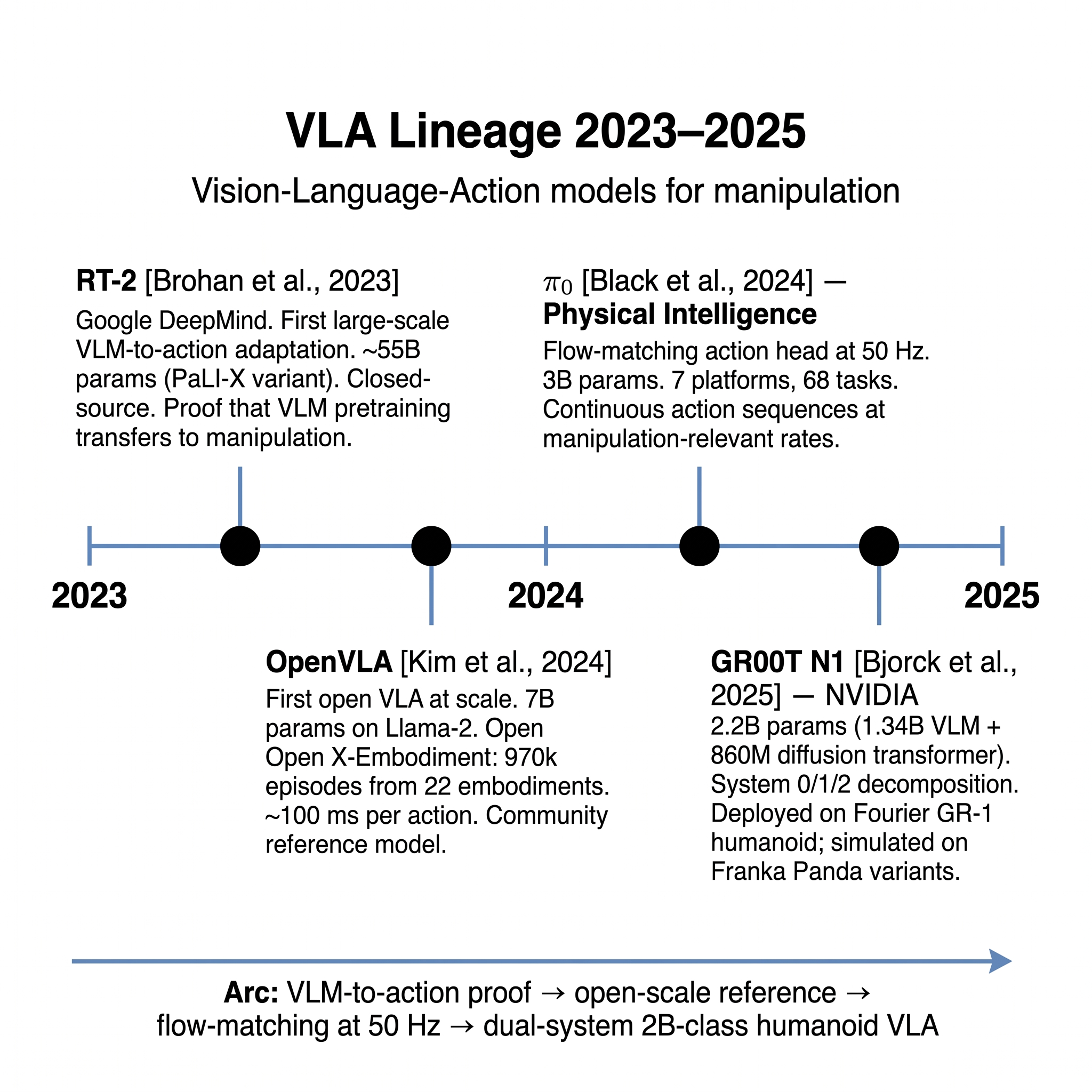

이 장은 여섯 주장으로 진행한다. 첫째(§10.2), 2023년 RT-2에서 2026년 프런티어까지의 계보를 추적하여 아키텍처 족보를 확립한다. 둘째(§10.3), 네 정통 오픈소스 VLA — RT-2, OpenVLA, π0, GR00T N1/N1.5 — 를 비교 세부 분석한다. 셋째(§10.4), 두 최대 비공개 또는 부분 비공개 프로덕션 VLA — Figure Helix와 AgiBot GO-1/GO-2 — 를 개관하고 공개 정보가 허용하는 곳에서 비교한다. 넷째(§10.5), loco-manipulation 통합 질문을 다룬다 — 조작(RT-2 계보)과 보행(Helix, TWIST)에서 성장한 VLA들이 어떻게 수렴하고 있는지. 다섯째(§10.6), 교차 embodiment 일반화를 핵심 경제적 타당성 질문으로 살펴본다. 여섯째(§10.7), 행동 디코더 설계 — diffusion, flow matching, tokenized 행동 — 와 규모로 추론 비용을 압축한 FAST 행동 토큰화 작업을 다룬다. §10.8은 데이터 규모 질문을, §10.9는 Toyota Research Institute의 Large Behavior Model을, §10.10은 이 장을 보완하는 연구 서베이를, §10.11은 Part III 판결과 열린 질문으로 닫는다.

10.2 VLA 계보 — RT-2에서 2026년 프런티어까지

현재 이해되는 VLA 범주는 Google DeepMind의 RT-2 [6]로 시작한다. RT-2의 아키텍처적 이동은 사전 학습된 vision-language 모델(PaLI / PaLM-E 가계)을 가져와 웹 규모 VQA 데이터와 같은 모델이 예측할 수 있는 토큰으로 이산화된 로봇 행동 코퍼스에 공동 학습시킨 것이다. 관찰이 놀라웠다. 인터넷 규모 이미지-텍스트 쌍을 본 VLM이 로봇 궤적에 미세 조정되면, 순수 로봇 행동 모델이 할 수 없는 새로운 물체와 새로운 언어 지시로 일반화했다. RT-2는 vision-language 사전 학습이 로봇 행동 미세 조정이 사전 학습된 지식을 파괴하지 않고 조작으로 전이한다는 것을 확립했다.

RT-2는 폐쇄 소스였고 학습 데이터는 독점이었다. OpenVLA [18]가 비교 가능한 규모의 첫 완전 오픈 VLA를 공개했다. 비전 인코더를 갖는 Llama-2에 구축된 70억 매개변수로, Open X-Embodiment (OXE) 데이터셋 [3]에 학습되며 22 로봇 embodiment에 걸친 약 970,000 episode를 포괄한다. 행동 head는 관절 공간 명령을 자기회귀 디코더가 예측하는 토큰으로 이산화한다. 추론은 소비자 GPU에서 행동당 약 100 ms다. OpenVLA는 규모로 교차 embodiment 일반화를 시연한 첫 오픈 VLA였다.

Physical Intelligence의 π0 [19]은 flow-matching 행동 head를 VLA에 도입했다. 이산적 행동 토큰을 예측하는 대신, 행동 head는 50 Hz에서 연속 행동 시퀀스를 생성하는 flow-matching 모델(8장 §8.6)이다. π0는 7 로봇 플랫폼과 68 과제의 혼합 코퍼스에 학습된다. 아키텍처 기여는 조작 관련 주파수(50 Hz)가 VLM 사전 학습의 이익을 타협하지 않고 VLA backbone에서 달성 가능함을 보이는 것이다. π0의 후속 π0.5 [22]은 접근을 개방 세계 일반화로 확장하고, π0-FAST [23]은 π0를 FAST 행동 토큰화 작업(§10.7)과 결합하여 자기회귀 효율성을 유지한다.

NVIDIA GR00T N1과 N1.5 [20]은 VLA를 이중 시스템 아키텍처로 재프레이밍하며, System 0/1/2 분해(9장)에 명시적으로 매핑된다. N1은 총 22억 매개변수다. System 2로서 13.4억 매개변수 VLM 플러스 System 1로서 8.6억 매개변수 diffusion transformer. GR00T는 시뮬레이션 롤아웃, 신경망 생성 궤적, 이전 MPC 롤아웃, 실 로봇 teleoperation 데이터의 혼합에 학습되며, 실세계 배치는 Fourier GR-1 휴머노이드에 이루어지고 시뮬레이션 전용 평가는 Franka Panda 팔 변종(단일 팔과 bimanual)으로 확장된다. GR00T N1.5는 유사한 매개변수 수로 N1 대비 약 10% 개선을 보고한다 — 규모 단계 상승이 아닌 아키텍처와 데이터 개선.

RT-2 → OpenVLA → π0 → GR00T N1 순서가 오픈 및 반오픈 VLA 계보를 정의한다. 폐쇄 소스 프로덕션 VLA — Figure Helix와 AgiBot GO-1/GO-2 — 는 이 계보와 나란히 앉고 다른 방식으로 프런티어를 차지한다(§10.4).

[6] (Google DeepMind, 약 55B params, VLM-to-action 증명) → OpenVLA [18] (7B 오픈소스 레퍼런스, Open X-Embodiment, 97만 episode) → π₀ [19] (Physical Intelligence, 50 Hz flow matching, 3B params) → GR00T N1 [20] (NVIDIA, 2.2B dual-system VLM + diffusion, Fourier GR-1 배포). 패러다임 호: VLM-to-action 증명 → 오픈 스케일 레퍼런스 → 50 Hz flow matching → 2B급 dual-system 휴머노이드 VLA. 저자 작성 일러스트 (Gemini 보조 재현)." loading="lazy" onerror="this.src='../assets/figures/ch10_vla_lineage_timeline.png'" style="cursor:zoom-in">

[6] (Google DeepMind, 약 55B params, VLM-to-action 증명) → OpenVLA [18] (7B 오픈소스 레퍼런스, Open X-Embodiment, 97만 episode) → π₀ [19] (Physical Intelligence, 50 Hz flow matching, 3B params) → GR00T N1 [20] (NVIDIA, 2.2B dual-system VLM + diffusion, Fourier GR-1 배포). 패러다임 호: VLM-to-action 증명 → 오픈 스케일 레퍼런스 → 50 Hz flow matching → 2B급 dual-system 휴머노이드 VLA. 저자 작성 일러스트 (Gemini 보조 재현)." loading="lazy" onerror="this.src='../assets/figures/ch10_vla_lineage_timeline.png'" style="cursor:zoom-in">

10.3 네 정통 오픈 VLA — 비교 분석

| 시스템 | 매개변수 | 행동 head | 주파수 | 학습 데이터 | 교차 embodiment 범위 |

|---|---|---|---|---|---|

| RT-2 [6] | ~55B (PaLI-X 변종) | 토큰화 | ~1–3 Hz | 독점 웹 + 로봇 혼합 | 단일 로봇 (Google 모바일 매니퓰레이터) |

| OpenVLA [18] | 7B | 토큰화 | ~10 Hz (100 ms/행동) | Open X-Embodiment (970k episode, 22 embodiment) | 학습에 의한 교차 embodiment |

| π0 [19] | 3B | flow matching | 50 Hz | 7 플랫폼, 68 과제 | 7 플랫폼 |

| GR00T N1 [20] | 2.2B (1.34B VLM + 860M diffusion) | diffusion transformer | ~120 Hz head / ~10 Hz VLM (L40) | 시뮬 + 인간 비디오 + teleop 혼합 | 실세계: Fourier GR-1 휴머노이드, 시뮬 전용: Franka Panda 팔 변종 |

표에서 네 관찰이 나온다.

매개변수 수는 시간이 지남에 따라 압축되었다. RT-2는 극도로 큰 다중모드 backbone을 썼다. 이후 VLA는 상당히 더 작고, GR00T N1은 RT-2 규모의 10% 미만이다. 압축은 분야의 점증하는 확신을 반영한다 — VLM 사전 학습 품질이 VLM 매개변수 수보다 행동 과제에 더 중요하다. 이미지, 텍스트, 코드에 잘 사전 학습된 더 작은 backbone이 추론 비용의 약 1/20로 RT-2의 일반화에 맞출 수 있다.

행동 head 설계는 발산했다. 토큰화된 행동(RT-2, OpenVLA)은 단순하고 LM 디코더를 재사용한다. trade-off는 행동 해상도와 다중 모드다. Flow matching(π0)과 diffusion(GR00T, Helix)은 행동당 추가 추론 스텝 비용으로 다중 모드 행동 분포를 자연스럽게 다룬다. FAST 행동 토큰화 작업 [24]은 신중히 설계된 행동 토큰이 자기회귀 단순성을 유지하면서 flow-matching 처리량에 맞을 만큼 효율적일 수 있음을 시연함으로써 이 간극을 부분적으로 닫는다.

주파수는 세대마다 증가했다. 1 Hz 미만 RT-2 작동은 평가된 모바일 조작 영역에 수용 가능했다. 휴머노이드 전신 제어는 10× 더 높은 주파수를 요구한다. 50 Hz의 π0와 휴머노이드급 속도의 GR00T가 2024+ 답이다. 속도는 여전히 9장의 System 1 목표 100–200 Hz보다 느리고, 프로덕션 휴머노이드 VLA가 전형적으로 그 아래에 더 빠른 System 1 / System 0 쌍을 또한 가지는 이유다.

교차 embodiment 학습이 이제 기본값이다. OpenVLA의 22 embodiment는 초기 채택 베팅이었다. 2025–2026년까지 모든 진지한 VLA가 다중 embodiment 데이터에 학습된다. 미해결 질문은 학습 집합 embodiment 커버리지가 배포 시 일반화를 보이지 않은 embodiment에 번역하는지 — §10.6의 주제.

10.4 Figure Helix와 AgiBot GO-1/GO-2 — 프로덕션 VLA

두 폐쇄 소스 프로덕션 VLA가 2025–2026년 휴머노이드 배포를 지배한다.

Figure Helix [33]는 "System 1 + System 2" VLA 명명에 대한 공개 참조다. Helix S2는 7–9 Hz의 온보드 인터넷 사전 학습된 VLM이다. Helix S1은 전체 상체에 걸쳐 S2의 latent semantic + 시각 + proprioception을 연속 관절 행동으로 매핑하는 200 Hz의 빠른 반응형 visuomotor 정책이다. Helix는 저전력 임베디드 GPU에서 완전히 온보드로 도는 것으로 보고된 첫 VLA였다. Helix 02 [34]는 두 계층 명명을 유지하고 그 아래에 System 0을 추가한다(9장 §9.2). 1 kHz의 1000만 매개변수 전신 제어기. 완전 Helix 02 스택 — 7B VLM + visuomotor 정책 + 1000만 System 0 — 은 리셋 없이 4분의 연속 식기세척기 로드와 61개 loco-manipulation primitive를 시연한 것으로 문서화되며, 밀리미터 핑거팁 동작에서 room-scale 보행까지 약 네 차수의 동적 범위를 갖는다 [34].

AgiBot GO-1 [31]은 Vision-Language-Latent-Action(ViLLA) 아키텍처 주위에 구축된다. 잠재 계획기(temporal 추론) 플러스 행동 expert(로봇 제어). GO-1은 AgiBot World 데이터셋 [31]을 도입했다. 5 배포 시나리오에 걸친 100 양팔 휴머노이드로부터 수집되었으며 217 과제와 100만 개 이상의 궤적을 커버한다. 이는 가장 큰 공개 휴머노이드 조작 코퍼스다. GO-1은 평가 suite에서 RDT 기준선 대비 +32% 성공, Open X-Embodiment 학습 정책 대비 +30%를 보고한다 [31]. AgiBot GO-2 [32]는 비동기 이중 시스템 아키텍처로 GO-1 위에 구축된다(9장 §9.1). System 2에서의 저주파수 semantic 계획 플러스 System 1에서의 고주파수 행동 추종, Genie Sim 3.0의 분리된 physics-rendering 파이프라인에서 돈다. GO-2는 ACL 2026 수용되었다.

Helix와 GO-2 아키텍처는 세 축에서 다르다. 첫째, Figure는 단일 기업 embodiment 체인에서 작동(Figure 02 → Figure 03)한다. AgiBot는 의도적으로 스케일된 휴머노이드 함대에서 작동(데이터 수집을 위한 100 휴머노이드)한다. 둘째, Figure는 모든 계층에서 온보드 추론을 강조한다. AgiBot의 비동기 프레이밍은 더 큰 compute 면과의 통신에 더 관대하다. 셋째, Figure의 데이터는 teleoperation 중심이다(2025 Helix 논문에서 500시간 미만으로 보고됨). AgiBot의 데이터는 수집-함대 중심이다(100 휴머노이드를 통한 100만 궤적). 각 아키텍처의 compute 지역성과 데이터 수집에 대한 베팅이 12장과 13장의 상세 분석을 알린다.

10.5 Loco-manipulation 통합

VLA 문헌은 수년간 조작-from-RT2와 보행-from-Radosavovic 계보 사이에 분열되었다. 통합 — 보행과 조작을 단일 문제로 다루는 전신 정책 — 이 2024–2025 프런티어다.

여러 시스템이 통합을 고정한다.

Expressive Whole-Body Control (ExBody) [7]은 Unitree H1에서 상체 추종(mocap 유래)을 하체 보행(험지 RL)에서 분리한다. 분리는 모듈성을 위한 설계 선택이었다. 이후 시스템은 더 타이트한 통합을 목표로 한다.

HumanPlus [8]은 RGB-to-humanoid 모방을 한다. 단일 카메라가 인간을 관찰하고, 포즈 추정이 SMPL-X 포즈를 생산하고, 재타게팅이 H1에 매핑하고, shadow 정책 보상이 Isaac Gym에서 휴머노이드를 학습시킨다. HumanPlus는 40 시연 미세 조정으로 전신 과제(복싱, 타이핑, 천 접기, 공 던지기)를 60–85% 성공으로 시연한다.

H2O와 OmniH2O [11]는 실시간 teleoperation으로 확장한다. H2O는 단일 RGB teleop으로 약 50 ms 지연에서 돈다. OmniH2O는 5-finger Inspire 손과 보편 재타게팅을 추가한다. 6시간의 teleop 데이터에 학습된 자율 정책은 60–90% 성공에 도달한다.

TWIST [28]는 VR 스타일 teleop을 mocap과 teleop에서 증류된 causal-Transformer 정책과 결합한다. Unitree G1에 배포되어 단일 정책으로부터 25+ 전신 기술을 생산하고 120 N 측면 푸시 회복을 낸다.

HOVER [11]는 200 Hz Jetson급 추론에서 15+ 뚜렷한 제어 모드를 갖는 2024 통합 전신 제어기다. Humanoid-VLA [36]는 VLA를 조작만이 아니라 동적 전신 제어로 명시적으로 밀어붙인다.

FALCON [29]은 힘 적응 전신 loco-manipulation을 추가한다 — 접촉 풍부 과제를 위한 힘 센싱 팔과 결합된 전신 정책. FALCON은 7장이 열린 sim-to-real 프런티어로 식별한 접촉 풍부 조작에 대한 가장 가까운 공개 선례다.

OmniRetarget [27]은 데이터 규모 활성화자다. 상호작용 메시 재타게팅을 통한 8+ 시간의 가해 재타게팅 궤적으로, zero 발 스케이팅(기준선의 ~18% 대비)으로 30초 휴머노이드 parkour를 지원한다. OmniRetarget의 기여는 VLA 자체의 상류에 있다 — 전신 VLA가 이익을 얻는 학습 데이터를 생산한다.

Perceptive Pedipulation [12]은 다른 통합 방향을 예시한다. 발이 매니퓰레이터로 쓰임(pedipulation), 로컬 장애물 회피와 함께. 개념은 pedipulation을 넘어 전신 VLA 프레임워크에서 전통적으로 보행(다리, 발)과 조작(팔, 손)에 할당된 사지가 동적으로 교환 가능하다는 더 넓은 점으로 일반화된다.

Visual Whole-Body Control [15]과 Mobile ALOHA [16]이 양손 조작 플러스 보행 선례다. Mobile ALOHA의 2024 규모 저비용 전신 teleoperation이 대부분의 휴머노이드 전신 teleoperation에 선행했다.

이 시스템 전반에 걸쳐 부상하는 통합 패턴: 보행은 해결된 primitive로 취급되고(Part II 판결), 조작이 상체 VLA를 통해 위에 타며, 둘 사이 인터페이스가 시스템별로 협상된다. Figure Helix는 단일 통합 visuomotor 정책을 쓴다. AgiBot은 이중 시스템 비동기 분할을 쓴다. HumanPlus/TWIST/HOVER는 mocap 또는 teleop으로부터의 증류를 쓴다. ExBody는 명시적 디커플링을 쓴다. 어떤 패턴도 아직 이기지 않았다.

10.6 교차 embodiment 일반화

상용 규모에서의 VLA의 경제적 전제는 단일 정책이 여러 로봇 SKU에 걸쳐 amortize될 수 있다는 것이다. 교차 embodiment 전이가 학습하지 않은 embodiment에 배포할 때 성공을 20% 이상 열화시키면, VLA 이야기는 embodiment별 미세 조정으로 무너지며, 이는 상당히 약한 가치 제안이다.

교차 embodiment 일반화에 대한 공개 증거는 혼합되어 있다. OpenVLA는 22 OXE embodiment에 학습되고 새 조작 과제에 비자명한 일반화를 보인다 [18]. GR00T N1은 실세계에서 단일 휴머노이드 embodiment(Fourier GR-1)에 배치되고, 시뮬레이션 전용 교차 embodiment 평가가 Franka Panda 팔 변종으로 확장된다 — 초기 커버리지가 시사한 것보다 좁은 교차 휴머노이드 증거 [20]. π0는 바퀴형 모바일 매니퓰레이터와 고정 팔을 포함한 7 플랫폼에 학습된다. 휴머노이드 특화 교차 embodiment는 주요 평가가 아니다 [19]. Helix는 Figure 02와 Figure 03에 시연되는데, 같은 기업 거의 동일 기구학이다 [Figure, 2025; Figure, 2026]. OmniH2O는 "단일 embodiment — 교차 embodiment는 커버되지 않음"을 한계로 명시적으로 플래그한다 [11]. HOVER는 15+ 제어 모드를 갖고 단일 embodiment에서 작동한다 [11].

이것이 critical-analyst의 gaps.md Gap 4가 식별하는 "교차 embodiment 전이는 주장되지만 체계적으로 벤치마크되지 않음" 간극이다. 엔지니어링 치료 — 잠재 행동 표현(GO-1의 ViLLA, PHC/PULSE 모션 잠재), visual proprioception 모델(Figure의 6D end-effector 자기 보정) — 은 부분 해결책이다. 첫 엄밀한 공개 벤치마크(통제된 과제 suite를 갖는 N≥5 뚜렷한 휴머노이드 embodiment)는 아마 18–30개월 이후다.

Part V에 대한 전략적 결과: 한국의 네 차별화 축(15장)은 교차 embodiment 전이를 축 4로 명시적으로 포함한다. 축이 2020년대 후반까지 열린 채로 남는다면, 한국 제조업체는 제조 SKU 다양성에 튜닝된 도메인 특화 교차 embodiment 작업(자동차 조립 라인 로봇 + 반도체 fab 로봇 + 조선 로봇을 하나의 정책 하에)으로 진입하여 방어 가능한 위치를 확립할 수 있다.

10.7 행동 디코더 — diffusion, flow, 토큰, FAST

행동 디코더는 VLA에서 다중 모드 관측-언어 컨텍스트를 실제 관절 명령으로 변환하는 부분이다. 네 접근이 지배한다.

토큰화된 행동(RT-2, OpenVLA)은 연속 행동 공간을 자기회귀 디코더가 한 번에 하나씩 예측하는 토큰으로 이산화한다. 이점은 아키텍처 단순성 — 언어 모델 디코더 재사용 — 이고, 단점은 행동 해상도가 토큰 입자도로 경계되고 순차 토큰 생성이 느리다는 것이다.

Diffusion 행동 정책(Diffusion Policy [5], GR00T N1의 diffusion transformer, Helix)은 noising 과정을 역전시킴으로써 행동 시퀀스를 생성한다. 다중 모드 행동 분포가 자연스럽게 등장한다. 추론은 행동당 O(denoising-steps)이며, 전형적으로 10–50 스텝.

Flow matching(π0, π0.5)은 base 분포에서 행동 분포로 학습된 속도 장을 적분함으로써 행동을 생성한다. 학습이 종종 diffusion보다 더 단순하다. 추론이 더 빠를 수 있다(비교 품질에 대해 더 적은 적분 스텝 필요).

FAST 토큰화 [24]은 자기회귀와 연속 접근 사이의 2025 다리다. FAST는 행동 시퀀스를 diffusion이 포착할 구조를 보존하지만 자기회귀 효율성을 유지하는 간결한 토큰 어휘로 압축한다. π0-FAST [23]은 π0를 FAST와 결합하여 효율성 이점의 일부를 회복한다. SmolVLA [25]는 경제성 지향 변종이다 — edge 배포를 위해 최적화된 작은 모델 VLA.

설계 공간 선택은 VLA가 무엇을 위한 것인지에 의존한다. 고주파수 전신 제어에 대해 행동당 더 적은 추론 스텝이 중요하다. Flow matching과 FAST가 2025+ 기본값이다. 다중 모드 행동 분포가 필수인 개방 세계 조작(여러 유효한 grasp, 여러 물체 접근 궤적)에 대해 diffusion은 강력하게 남는다. 행동 공간이 움직이는 목표인 교차 embodiment 전이에 대해 토큰화는 재학습이 부분적으로 흡수하는 균일한 추상화를 제공한다.

ACT (Action Chunking with Transformers) [4]은 표준 VLA 기법으로서 한 번에 여러 시간스텝 행동을 예측하는 action chunking을 확립한 2023 선행자다. ACT는 diffusion-policy 및 FAST-tokenization 라인 모두에 영향을 주었다.

Universal Manipulation Interface (UMI) [17]은 다른 혁신 축이다. 하드웨어 중립적 데이터 수집 도구(카메라 포함 휴대용 gripper)로 실세계 인간 조작 시연을 포착하고, 이후 로봇 정책을 학습시킨다. UMI는 디코더 아키텍처 문제가 아니라 데이터 희소성 문제(§10.8)를 다룬다.

10.8 VLA에 대한 데이터 규모

VLA는 언어 모델의 스케일링 직관을 상속한다. 더 많은 데이터, 더 나은 정책. VLA에 대한 데이터 규모 질문은 세 하위 질문을 갖는다.

실 로봇 데이터 규모. 가장 큰 공개 휴머노이드 특화 데이터셋은 100 휴머노이드와 217 과제에 걸친 약 100만 궤적의 AgiBot World다 [31]. 모든 로봇 플랫폼에 걸쳐(OXE 규모) 약 970,000 episode가 공개되어 있다 [3]. Helix의 보고된 500시간 teleop 코퍼스는 상당히 더 작지만 더 일관적(같은 하드웨어, 같은 과제)이다.

시뮬레이션 데이터 규모. GR00T N1은 학습 혼합에 "신경망 생성 궤적"을 쓰고 [20], AgiBot World 논문은 시뮬레이션 생성 궤적 증강을 주목한다. 100만 궤적(실)과 1억+ 궤적(시뮬, 규모의 Isaac Lab으로 달성 가능) 사이 간극은 상당하지만, 시뮬레이션 조작 전이는 접촉 충실도(5장 §5.5)에 의해 제한된 채 남는다.

인간 비디오 데이터 규모. Radosavovic 외의 2024-nexttoken [37]은 인간 비디오 토큰 추가가 휴머노이드 보행에 대한 RL 전용 기준선 대비 푸시 회복을 ~25% 개선한다고 보고한다. UMI [17]와 이전 Ego4D 스타일 데이터셋이 스케일링 코퍼스다. 질문은 인간 비디오 사전 학습이 보행에 전이하는 만큼 효과적으로 휴머노이드 조작에 전이하는지다. 현재 증거는 양가적이다.

집계 데이터 질문 — 어떤 실 로봇, 시뮬레이션, 인간 비디오 데이터 혼합이 최고의 VLA를 생산하는지 — 은 아직 해결되지 않았다. 현재 프로덕션 스택은 원칙적 스케일링 법칙이 아니라 엔지니어링 제약(Figure의 작지만-일관적 teleop 베팅 vs AgiBot의 크지만-가변적 함대 수집 베팅)에 의해 추동된 비율로 셋 모두를 혼합한다. 첫 엄밀한 휴머노이드 VLA 스케일링 법칙 논문은 근미래 연구 기회다(8장 §8.9).

10.9 Toyota Research Institute와 Large Behavior Models

Toyota Research Institute의 Large Behavior Model (LBM) [14]은 Boston Dynamics의 Electric Atlas(11장)에 대한 S2 계층을 차지하는 연구실급 프로그램이다. LBM은 Diffusion Policy [5] 기반에 구축되고 다과제 학습, 데이터 스케일링 실험, TRI의 연구 함대를 통한 실 하드웨어에서의 배포를 강조한다. LBM의 명시적 프레이밍은 "다양한 조작 데이터에 사전 학습된, 그리고 과제별로 가볍게 미세 조정된 단일 정책"이 배포 가능한 VLA 레시피라는 것이다 — OpenVLA와 π0에 가깝고 Figure의 단일 가중치 집합 접근과 다른 입장.

LBM은 VLA 연구가 모든 학습 세부를 갖는 결정적 공개 논문을 아직 공개하지 않은 경우다. 공개는 tech-talk와 부분 공개다. LBM의 의의는 아키텍처적이기보다 제도적이다. 그것은 학습된 VLA 접근이 Boston Dynamics의 하드웨어로 스케일하는지를 테스트하는 TRI의 Atlas 협업이며, BD의 하이브리드-MPC+RL-plus-VLA 파이프라인에 대한 S2 후보다.

10.10 동반 서베이

세 2024–2025 서베이가 이 장을 보완하며 이 장이 제공하는 내러티브를 넘어 기법 카탈로그 깊이를 원하는 독자를 위해 지명할 가치가 있다.

Kroemer, Niekum, Konidaris (2021) [1]이 조작을 위한 로봇 학습의 정통 VLA 이전 리뷰다. 독자가 하위 분야로서 조작 학습에 새롭다면 좋은 선수 지식.

Wolf 외 (2025) [35]이 기법 카탈로그 깊이에서 로봇 조작을 위한 diffusion 모델을 조사하며, diffusion-policy 계보, flow matching, 토큰화 변종, 2024–2025 확장을 커버한다.

Weinberg 외 (2024) [13]이 로봇 in-hand 조작에 대한 학습 기반 접근을 조사한다 — 대부분의 휴머노이드 VLA가 현재 목표로 하는 전신 조작보다 상당히 더 어려운 dexterous 조작 하위 분야.

Billard와 Kragic (2019) [2]이 딥러닝 이전 조작 리뷰다 — Kober 2013이 RL의 딥 이전 시대를 현대 정전에 연결하는 방식과 유사하게 고전적-현대적 다리에 유용하다.

10.11 판결과 열린 질문

Part III 판결(통합된 9장 + 10장 요약): 해결된 아키텍처, 부분 해결된 loco-manipulation. System 0/1/2 아키텍처(9장)는 2026 배포를 위한 교차 기업 lingua franca다. VLA 모델은 이제 문서화된 전신 loco-manipulation 역량을 갖는 프로덕션 품질(Figure Helix 02, AgiBot GO-2, NVIDIA GR00T N1.5)에 존재한다. 아키텍처는 해결되었다. 프런티어는 잔차 통합 품질에 있다.

세 열린 질문이 이 장을 닫는다.

첫째, 엄밀한 교차 embodiment 벤치마크는 어떻게 생겼고 누가 출판할 것인가? 벤치마크가 VLA 문헌에 누락된 단일 가장 중요한 것이다. 최소 5개의 뚜렷한 휴머노이드 embodiment(Unitree G1, Figure 03, Digit, GR-1, H1)에 대한 조율된 접근과 통제된 과제 suite가 필요하다. 벤치마크는 단일 기업보다 연구 컨소시엄에서 나올 가능성이 높다. 학술-산업 컨소시엄(CoRL 워크샵, NeurIPS datasets track)이 가능한 수단이다.

둘째, 접촉 풍부 조작 VLA가 조작 전용 VLA의 성공률에 맞을 수 있는가? 보행과 조작을 통합하는 전신 정책(FALCON, HOVER, Humanoid-VLA)은 증명 가능하게 유능하지만 접촉 풍부 과제에 대한 조작 성공률은 목적 구축된 조작 VLA에 뒤처진다. 간극이 15장의 차별화 축 주장이 하중을 지탱하는 이유다. 접촉 풍부 제조 과제가 정확히 전신 + 힘 센싱 통합이 아직 수렴하지 않은 체제다.

셋째, BFM(Behavior Foundation Model) 프레이밍이 VLA 연구의 다음 2–3년의 올바른 조직 원리인가? BFM 서베이 [36]는 그렇다고 주장한다. 이 장의 프레이밍 — VLA-as-S1/S2-실현을 갖는 System 0/1/2 아키텍처 — 은 BFM과 양립하지만 사전 학습 프레임워크 측면보다 배포 아키텍처 측면에 초점을 맞춘다. 두 관점 모두 계속 발전할 것이다. 질문은 그들이 통합된 "System 0/1/2 아키텍처에 사전 학습된 BFM" 프레이밍으로 병합되는지 또는 상보로 남는지다.

10.12 Part IV로의 다리

4–10장이 기술과 아키텍처 기저층을 감사했다. Part IV(11–13장)는 기저층을 인스턴스화하는 기업을 살펴본다. Boston Dynamics의 하이브리드 MPC+RL+LBM 아키텍처(11장), US 도전자 Figure와 Agility 및 Tesla Optimus 전망(12장), 중국의 Unitree와 AgiBot 지도자(13장). 각 장은 기술-전략 분석이다 — 조달 가이드나 재무 모델이 아니다 — Part II와 III가 확립한 렌즈를 통해 기업의 공개 아키텍처를 읽는다.

참고문헌

- Kroemer, O., Niekum, S., & Konidaris, G. (2021). A review of robot learning for manipulation: Challenges, representations, and algorithms. JMLR.

- Billard, A., & Kragic, D. (2019). Trends and challenges in robot manipulation. Science.

- Padalkar, A., et al. (2023). Open X-Embodiment: Robotic learning datasets and RT-X models. arXiv preprint.

- Zhao, T. Z., Kumar, V., Levine, S., & Finn, C. (2023). Learning fine-grained bimanual manipulation with low-cost hardware (ACT). Proc. RSS.

- Chi, C., et al. (2023). Diffusion policy: Visuomotor policy learning via action diffusion. Proc. RSS.

- Brohan, A., et al. (2023). RT-2: Vision-language-action models transfer web knowledge to robotic control. arXiv preprint.

- Cheng, X., et al. (2024). Expressive whole-body control for humanoid robots. Proc. RSS. arXiv:2402.16796.

- Fu, Z., et al. (2024). HumanPlus: Humanoid shadowing and imitation from humans. Proc. CoRL.

- He, T., et al. (2024). Learning human-to-humanoid real-time whole-body teleoperation (H2O). Proc. IEEE/RSJ IROS.

- He, T., et al. (2024). OmniH2O: Universal and dexterous human-to-humanoid whole-body teleoperation and learning. Proc. CoRL.

- He, T., et al. (2024). HOVER: Versatile neural whole-body controller for humanoid robots. Proc. IEEE ICRA 2025.

- Grandia, R., et al. (2024). Perceptive pedipulation with local obstacle avoidance.

- Weinberg, A., et al. (2024). Survey of learning-based approaches for robotic in-hand manipulation.

- Tedrake, R. (2024). Toyota Research Institute Large Behavior Models for robot manipulation. TRI presentations and partial releases.

- Liu, S., et al. (2024). Visual whole-body control for legged loco-manipulation.

- Wang, A., et al. (2024). Mobile ALOHA: Learning bimanual mobile manipulation with low-cost whole-body teleoperation.

- Ha, H., et al. (2024). Universal manipulation interface: In-the-wild robot teaching without in-the-wild data (UMI).

- Kim, M. J., et al. (2024). OpenVLA: An open-source vision-language-action model.

- Black, K., et al. (2024). π0: A vision-language-action flow model for general robot control.

- Bjorck, J., et al. (2025). GR00T N1: An open foundation model for generalist humanoid robots.

- NVIDIA. (2025). GR00T N1.5: Improved foundation model for generalist humanoid robots.

- Physical Intelligence. (2025). π0.5: A vision-language-action model with open-world generalization.

- Black, K., et al. (2025). π0-FAST: Autoregressive π0 with FAST tokenizer.

- Pertsch, K., et al. (2025). FAST: Efficient action tokenization for vision-language-action models.

- Shukla, S., et al. (2025). SmolVLA: A vision-language-action model for affordable and efficient robotics.

- Yang, H., et al. (2025). Humanoid-VLA: Generalist VLA with dynamic whole-body control.

- Yang, H., et al. (2025). OmniRetarget: Interaction-preserving data generation for humanoid whole-body loco-manipulation and scene interaction.

- Ze, Y., et al. (2025). TWIST: Teleoperated whole-body imitation system.

- Zhang, J., et al. (2025). FALCON: Learning force-adaptive humanoid loco-manipulation.

- AgiBot. (2025). AgiBot World Colosseo: A large-scale manipulation platform.

- AgiBot. (2025). AgiBot GO-1: ViLLA generalist embodied foundation model.

- AgiBot. (2026). AgiBot GO-2: Asynchronous dual-system architecture.

- Figure AI. (2025). Helix: A vision-language-action model for generalist humanoid control.

- Figure AI. (2026). Figure 03 + Helix 02: General-purpose humanoid system.

- Wolf, R., Shi, Y., Liu, S., & Rayyes, R. (2025). Diffusion models for robotic manipulation: A survey.

- Yuan, M., et al. (2025). A survey of behavior foundation model: Next-generation whole-body control system of humanoid robots. arXiv preprint 2506.20487.

- Radosavovic, I., et al. (2024). Humanoid locomotion as next token prediction. NeurIPS. arXiv:2402.19469.